Яндекс запустил новый алгоритм ранжирования - «Королев». Теперь поисковая система сопоставляет смыслы поискового запроса и страницы. Это очень удобно для пользователей. Однако что новый алгоритм означает для оптимизаторов и владельцев сайтов, как изменится продвижение и стоит ли ждать изменения трафика.

Как никогда весь «сеошный» мир ждал запуска нового алгоритма ранжирования, анонсированного на 22 августа 2017 года. Ещё бы, подобные анонсы – вещь для Яндекса абсолютно нетипичная, обычно они предпочитают не распространяться о своих планах, и сообщают об очередном релизе алгоритма ранжирования постфактум.

22 августа 2017 года Яндекс запустил новую версию поиска. В её основе лежит поисковый алгоритм «Королёв» (с 2008-го года новые алгоритмы ранжирования в Яндексе называют в честь городов). Алгоритм с помощью нейронной сети сопоставляет смысл запросов и веб-страниц - это позволяет Яндексу точнее отвечать на сложные запросы. Для обучения новой версии поиска используются поисковая статистика и оценки миллионов людей. Таким образом, вклад в развитие поиска вносят не только разработчики, но и все пользователи Яндекса.

Область применения нового алгоритма практически не затрагивает традиционные сеошные сферы интересов, в первую очередь к которым можно отнести коммерческую выдачу. «Королёв» оказался логическим продолжением алгоритма «Палех» и призван обслуживать длинный хвост микрочастотных запросов, как правило, задаваемых на естественном языке. Особенностью таких запросов является то, что релевантные им документы могут не содержать многих из слов, входящих в запрос. Это ставит в тупик традиционные алгоритмы ранжирования, основанные на текстовой релевантности.

Решение найдено в виде использования нейросетей, которые обучаются в том числе и на поведении пользователей. Поэтому новый алгоритм Яндекса работает на основе нейронной сети. Он обучается на примерах запросов пользователей, и подбирает ответы исходя из смысла текста на странице. Это означает, в частности, что он будет гораздо эффективнее работать с нестандартными запросами, когда пользователи сами не уверены, как называется то, что они хотят найти. Здесь многое упирается в вычислительные мощности.

Вообще подобный подход к решению задачи ранжирования длинного микрочастотного хвоста запросов не нов. Еще в 2015-м году стало известно о технологии, применяемой поисковой системой Google для поиска ответов на многословные запросы, заданные на естественном языке – RankBrain. Эта технология, так же основанная на машинном обучении, позволяет распознавать наиболее значимые слова в запросах, и анализировать контекст, в котором осуществляется поиск. Что позволяет находить релевантные документы, которые не содержат всех слов запроса.

Кроме того, алгоритм работает и с картинками. Он анализирует содержание изображения и подбирает необходимый вариант, исходя из него, а не только из описания в тегах или окружающего его текста.

Впрочем, длинный хвост микрочастотных многословных запросов на естественном языке вполне может быть интересен «выжигателям» информационной семантики – создателям так называемых инфосайтов «на все случаи жизни». В общем-то, они и так стараются под как можно большее количество известных им запросов, которые удается заполучить с помощью различных методов сбора семантики, организовать точное вхождение в свои тексты. Там же, где точных вхождений не будет, т.е. для запросов, которые не всосал «семантический пылесос» создателей инфосайтов или для которых им не удалось обеспечить точных вхождений в контент, и начинается вотчина «Королёва», который призван искать соответствия между запросами и ответами в том случае, когда между ними мало пересечений по ключевым словам. В таких случаях «Королёв» несомненно повысит требования к качеству контента, и реально интересные читабельные статьи будут еще больше выигрывать у сборников вхождений ключевых фраз, разбавленных водой, т.к. именно в таких статьях могут содержаться полезные для нового алгоритма сигналы. Ну, а всем остальным сеошникам действительно можно расслабиться – очередная порка откладывается. Жертв и разрушений нет.

Запуская «Палех», Яндекс научил нейронную сеть преобразовывать поисковые запросы и заголовки веб-страниц в группы чисел - семантические векторы.

Важное свойство таких векторов состоит в том, что их можно сравнивать друг с другом: чем сильнее будет сходство, тем ближе друг к другу по смыслу запрос и заголовок.

Чем он отличается от «Палеха»?

Основным отличием нового алгоритма, помимо улучшения технической реализации, является возможность распознавать схожие «смыслы» по всему документу, а не только по заголовку (Title), который появляется в окне браузера.

Как работает алгоритм «Королёв»

Поисковый алгоритм «Королёв» сравнивает семантические векторы поисковых запросов и веб-страниц целиком - а не только их заголовки. Это позволяет выйти на новый уровень понимания смысла.

Как и в случае с «Палехом», тексты веб-страниц в семантические векторы преобразует нейросеть. Эта операция требует много вычислительных ресурсов. Поэтому «Королёв» высчитывает векторы страниц не в режиме реального времени, а заранее, на этапе индексирования.

Когда человек задаёт запрос, алгоритм сравнивает вектор запроса с уже известными ему векторами страниц.

Эффект «Королёва»

Умение понимать смысл особенно полезно при обработке редких и необычных запросов - когда люди пытаются описать своими словами свойства того или иного объекта и ожидают, что поиск подскажет его название.

Такая схема позволяет начать подбор веб-страниц, соответствующих запросу по смыслу, на ранних стадиях ранжирования. В «Палехе» смысловой анализ - один из завершающих этапов: через него проходят всего 150 документов. В «Королёве» он производится для 200 000 документов.

Кроме того, новый алгоритм не только сравнивает текст веб-страницы с поисковым запросом, но и обращает внимание на другие запросы, по которым люди приходят на эту страницу.

Так можно установить дополнительные смысловые связи.

Люди учат машины

Использование машинного обучения, а особенно нейросетей, рано или поздно позволит научить поиск оперировать смыслами на уровне человека. Чтобы машина поняла, как решать ту или иную задачу, необходимо показать ей огромное количество примеров: положительных и отрицательных. Такие примеры дают пользователи Яндекса.

Нейронная сеть, которую использует алгоритм «Королёв», обучается на обезличенной поисковой статистике. Системы сбора статистики учитывают, на какие страницы пользователи переходят по тем или иным запросам и сколько времени они там проводят.

Если человек открыл веб-страницу и «завис» там надолго, вероятно, он нашёл то, что искал, - то есть страница хорошо отвечает на его запрос. Это положительный пример.

Подобрать отрицательные примеры гораздо легче: достаточно взять запрос и любую случайную веб-страницу.Статистика, которая используется для обучения алгоритма, обезличена

В помощи людей нуждается и Матрикснет, который строит формулу ранжирования.

Толока

Чтобы поиск развивался, люди должны постоянно давать оценку его работе. Когда-то выставлением оценок занимались только сотрудники Яндекса - так называемые асессоры. Но чем больше оценок, тем лучше - поэтому Яндекс привлек к этому всех желающих и запустили сервис Яндекс.Толока . Сейчас там зарегистрировано более миллиона пользователей: они анализируют качество поиска и участвуют в улучшении других сервисов Яндекса. Задания на Толоке оплачиваются - сумма, которую можно заработать, указана рядом с заданием. За два с лишним года существования сервиса толокеры дали около двух миллиардов оценок.

В основе современного поиска лежат сложные алгоритмы. Алгоритмы придумывают разработчики, а учат - миллионы пользователей Яндекса. Любой запрос - это анонимный сигнал, который помогает машине всё лучше понимать людей. Новый поиск - это поиск, который мы делаем вместе.

Все мы не понаслышке знаем о существующих алгоритмах поисковых систем Яндекс и Google. Именно для соблюдения их «постоянно обновляемых» правил все оптимизаторы ломают свой мозг все новыми и новыми способами попасть в ТОП выдачи поиска. Из последних новшеств, которые ощутили на себе владельцы сайтов со стороны ПС — это требования к мобильности интернет-ресурсов и понижение в поиске тех площадок, которые не умеют покупать ссылки . Какие алгоритмы до этого времени, внедренные в поиск, существенно повлияли на ранжирование сайтов? На самом деле, не все оптимизаторы знают, какие технологии, когда и зачем были созданы, чтобы максимально справедливо дать позицию каждому сайту в поиске и очистить выдачу от «хлама». Историю создания и развития поисковых алгоритмов мы и рассмотрим в этой статье.

Яндекс: виды алгоритмов с зачатия до сегодня

Алгоритмы не создавались все в один день, и каждый из них проходил много этапов доработки и преобразования. Основная масса названий алгоритмов Яндекса состоит из названий городов. Каждый из них имеет свои принципы работы, точки взаимодействия и уникальные функциональные особенности, гармонично дополняющие друг друга. Какие алгоритмы есть у Яндекса и как они влияют на сайты, рассмотрим далее.

Помимо информации о поисковых алгоритмах полезной будет и статья про . Советы по созданию качественного SEO-контента подходящего для поисковиков Гугл и Яндекс я предлагаю вам прочесть .

Магадан

Алгоритм «Магадан» распознает аббревиатуры и отожествляет существительные с глаголами. Был впервые запущен в тестовом режиме в апреле 2008, а вторая постоянная версия вышла в свет в мае того же года.

Особенности

«Магадан» выдает пользователю, который написал аббревиатуру, сайты и с расшифровками. Например, если в поисковой строке вбили запрос МВД, то кроме площадок с таким ключевым словом в списке будут присутствовать и те, у кого аббревиатуры нет, но есть расшифровка «Министерство внутренних дел». Распознавание транслитерации дало пользователям возможность не думать на каком языке правильно писать названия, к примеру, Mercedes или Мерседес. Ко всему этому Яндекс включил в список индексирования почти миллиард зарубежных сайтов. Распознавание частей речи и признание их равноценными поисковыми запросами выпустили в один поиск сайты с разными ключевыми фразами. То есть теперь по ключевику «оптимизация сайтов» в выдаче выводятся и площадки с вхождением словосочетания «оптимизировать сайт».

Результаты

После запуска алгоритма «Магадан» стало труднее, в основном, малоавторитетным сайтам. В ранжировании понизились позиции по релевантным запросам малопосещаемые и молодые ресурсы, а на первые места выдвинулись авторитетные, даже с некачественным контентом, учитывая при этом морфологию и разбавленность ключевиков. Из-за учета транслитерации в ТОП Рунета вышли и зарубежные ресурсы. То есть оптимизированный текст по теме мог оказать на второй странице, только потому, что, якобы, по этой же тематике есть более посещаемый сайт или аналогичный зарубежный. Из-за этого резко возросла конкуренция по низкочастотным ключевикам и иностранным фразам. Подорожала и реклама — ставки возросли, потому что ранее сайты конкурировали только по одному конкретному запросу, а теперь и с «коллегами» с морфологическими фразами, транслитерацией, переходящими в другую часть речи словами.

Находка

Алгоритм «Находка » — расширенный тезаурус и внимательное отношение к стоп-словам. Выпущен «на ринг» сразу после «Магадана». Ранжирует основную выдачу с сентября 2008.

Особенности

Это инновационный подход к машинному обучению — ранжирование стало четче и корректней. Расширенный словарь связей и внимательность к стоп-словам в алгоритме «Находка» очень сильно повлияли на поисковую выдачу. К примеру, запрос «СЕО оптимизация» теперь ассоциировался и с ключем «сеооптимизация», а коммерческие сайты разбавлялись информационными порталами, в том числе в списке появились развернутые сниппеты с ответами, по особенному отображалась Википедия.

Результаты

Коммерческие сайты сделали больший акцент на продажные запросы, так как конкуренция увеличилась по информационным не конкретным фразам в несколько раз. В свою очередь, информационные площадки смогли расширить свою монетизацию с помощью страниц рекомендаций, участвуя в партнерских программах. Топовые инфосайты, продвинутые по коммерческим запросам стали продавать ссылки на заказ. Конкуренция ужесточилась.

Арзамас

Алгоритм «Арзамас» — внедрена лексическая статистика поисковых запросов и создана географическая привязка сайта. Первая версия «Арзамаса» (апрель 2009) без геозависимости выпущена сразу в основную выдачу, а «Арзамас 2» с классификатором по привязке сайта к региону анонсирован в августе 2009.

Особенности

Снятие привязки к омонимам облегчила пользователю жизнь, ведь теперь по фразе «американский пирог» выдавались только сайты на тему фильмов, без всяких там рецептов десертов, как могло быть раньше. Привязка к региону совершила прорыв, сместив ключевые фразы с добавкой города на несколько пунктов вниз. Теперь пользователь мог просто ввести слово «рестораны» и увидеть в лидерах только сайты из города его местонахождения. Если помните, раньше нужно было бы ввести более конкретную фразу, например «Рестораны в Санкт-Петербурге», иначе Яндекс мог выдать ответ «уточните запрос — найдено слишком много вариантов». Геонезависимые ключевые слова выдавали только релевантные запросу сайты из любых регионов, без привязки.

Результаты

Ура! Наконец-то сайты из небольших регионов перестали конкурировать с крупными мегаполисами. Выйти в ТОП по своему региону теперь намного проще. Именно в этот период времени была предложена услуга «региональное продвижение». Алгоритм «Армазас» дал возможность мелким компаниям быстрее развиваться в своей местности, но подвох все равно остался. Яндекс не мог определить геолокацию у всех площадок. И как вы сами понимаете — без привязки ресурсы оставались, мягко говоря, в одном не очень приятном месте. Рассмотрение заявки на геозависимость могло длиться несколько месяцев, а молодые сайты без трафика и ссылочной массы (было ограничение по ТИЦ), вообще, не могли подать запрос на присвоение им региональности. Палка о двух концах.

Снежинск

Алгоритм «Снежинск» — усиление геозависимости и уточнение релевантности запросов к выдаче с помощью технологии машинного обучения «Матрикснет». Анонс состоялся в ноябре 2009, а улучшенная модель под именем «Конаково» заработала в декабре того же года.

Особенности

Поисковая выдача стала более точной к вводимым вопросам. Особую роль теперь играет привязка по геолокации — коммерческие сайты не ассоциировались у алгоритма «Снежинск» с регионами, поэтому выпадали из выдачи. Ключевые слова, не привязанные к местности, отожествляются с информационными ресурсами. Сложная архитектура подсчета релевантности сильно усложнила жизнь оптимизаторов, которые заметили, что при малейшем изменении одного из показателей, позиция сайта в выдаче моментально изменялась.

Результаты

На тот момент было отмечено, что закупка внешних ссылок на молодые сайты влияла на показатели новых ресурсов слишком вяло, если сравнить аналогичную закупку на площадку, давненько находящуюся на интернет-рынке. Новые методы определения релевантности контента к поисковым запросам выбрасывали из выдачи сайты, тексты которых были перенасыщены ключевыми фразами. Началась новая эра качественного текста, где во всем должна была быть мера, без нее площадка могла просто попасть под санкции за спам. Коммерческие ресурсы забили панику, потому что выйти по геонезависимым ключевым словам в ТОП (а они были самые высокочастотные) было практически нереально. В связи с этим на блоге Яндекса была опубликована запись, что в идеале хотелось бы видеть на первых страницах коммерческие организации, которые не пишут красиво, а выполняют свою работу хорошо, но для этого придется научить алгоритмы оценивать качество предлагаемых услуг. Так как на данный момент это оказалось непосильной задачей, репутация коммерческих интернет-ресурсов играла ключевую роль в выдаче, как в онлайне так и в оффлайне.

Обнинск

Алгоритм «Обнинск» — улучшение ранжирования и расширения базы географической принадлежности интернет-площадок и снижение влияния на показатели сайта искусственных СЕО-ссылок. Запущен в сентябре 2010.

Особенности

Падает популярность закупки ссылочных масс, появляется понятие «ссылочного взрыва», которого теперь боялись все. Конкуренты могли навредить друг другу возможностью введения алгоритма в заблуждение, закупив на «коллегу» огромное количество ссылок с «плохих источников». После этого конкурент выпадал из поисковой выдачи и долго не мог туда попасть. Геозависимые слова чаще добавляются на разные страницы коммерческих сайтов, чтобы обратить внимание робота на работу с этим регионом.

Результаты

Коммерческие сайты теперь тщательней относятся к своей репутации, что не может не радовать, но многие все равно прибегали к грязным методам (искусственно завышали посещаемость и покупали отзывы). После выпуска алгоритма «Обнинск» более популярной стала закупка вечных ссылок и статей, обычная покупка ссылок уже так не влияла на ранжирование, как раньше, а в случае попадания источника бэклинка под санкции могла потянуть за собой цепную реакцию. Качественные СЕО-тексты — обязательный атрибут любого ресурса. Молодой сайт с уникальным и правильно оптимизированным контентом мог попасть в ТОП.

Краснодар

Алгоритм «Краснодар» — внедрение технологии «Спектр» для разбавления поисковой выдачи, расширения сниппетов и индексация социальных сетей. Запуск состоялся в декабре 2010 года.

Особенности

Технология «Спектр» была создана для классификации запросов по категориям и использовалась в случаях ввода не конкретизированных ключевых фраз. «Краснодар» разбавлял поисковую выдачу, предлагая такому пользователю больше разнообразных вариантов. Например, при фразе «фото Москвы» в поиске можно было увидеть не только общие пейзажи, но и фотографии по категориям типа «достопримечательности», «карты», «рестораны». Был сделан акцент на уникальные названия чего-либо (сайтов, моделей, товаров) — конкретика стала выделяться. Расширенные сниппеты дали возможность сразу в поисковой выдаче показывать пользователям контакты и другие данные организаций.

Результаты

Сильно изменилось ранжирование коммерческих сайтов, особое внимание уделяется деталям (карточкам товаров, разделением короткого описания от общего). Социальная сеть в ВК начала индексироваться и профили участников равноценно теперь видны прямо в поисковой выдаче. Сообщения в форумах могли занимать первые позиции, если имели более расширенный ответ на вопрос пользователя, чем другие сайты.

Рейкьявик

Алгоритм «Рейкьявик» — создана персонализация поисковой выдачи и добавлена технологи «Колдунщики» для отображения предварительных итогов запроса. Улучшена формула подсказок при вводе. Алгоритм запущен в августе 2011 года.

Особенности

Девизом персонализированного поискового результата — «Каждому пользователю — своя выдача». Система запоминания интересов ищущих работала через куки, поэтому если запросы пользователя чаще были связаны, например, с зарубежными ресурсами, в следующий раз в лидерах поисковой выдачи отображались именно они. Подсказки в поисковой строке обновляются каждый час, тем самым расширяя возможности конкретизированного поиска. Конкуренция по высокочастотным запросам возрастает с неимоверной силой .

Результаты

Авторитетные новостные сайты чаще попадают в ТОП из-за расширенного семантического ядра (наличие огромного количества разных низкочастотных ключевых запросов). Увеличение количества страниц под конкретные поисковые запросы на информационных сайтах стала играть одну из главных ролей после выпуска алгоритма «Рейкьвик». Каждая площадка пыталась попасть в закладки пользователя, чтобы стать частью системы персонализации, для этого использовались методы подписки на RSS ленту, всплывающие баннеры-подсказки для занесения сайта в закладки. Интернет-ресурсы начали больше уделять внимания индивидуальному подходу, а не давить на массы.

Калининград

Алгоритм «Калининград» — глобальная персонализация поиска и поисковой строки, упор на поведенческие факторы. Запуск «Калининграда» в декабре 2012 существенно повысил стоимость seo услуг.

Особенности

Интересы пользователя перевернули с ног на голову всю поисковую выдачу — владельцы сайтов, ранее не заботившиеся о комфорте пребывания посетителя на сайте, стали терять трафик с молниеносной скоростью. Теперь Яндекс делил интересы на краткосрочные и долговременные, обновляя свои шпионские базы раз в сутки. Это означало, что сегодня и завтра по одному и тому же запросу одному и тому же пользователю могла показываться совершенно иная выдача. Интересы теперь играют особую роль и пользователю, который ранее интересовался поездками, вбивая фразу такси — показываются услуги такси, а тому, кто постоянно смотрит фильмы — получит в результатах поиска все о кинокомедии «Такси». В поисковой строке каждого «страждущего найти информацию» теперь на первых позициях отображаются подсказки по предыдущим интересам.

Результаты

Оптимизаторы стали охватывать все больше способов задержать пользователя: улучшалось юзабилити, дизайн, контент создается более разнообразный и качественный. При выходе могли всплывать окна типа «вы уверены, что хотите покинуть страницу» и в пользователя впивалась грустная рожица какого-то существа. Хорошо продуманная перелинковка страниц и всегда доступное меню улучшали показатели активности пользователей, чем повышали позиции сайтов в поисковой выдаче. Малопонятные широкому кругу интернет-пользователей сайты сначала просто понижались в позициях, а после и вообще болтались в конце списка предложенных результатов.

Дублин

Алгоритм «Дублин» — улучшена персонализация с помощью определения текущих целей. Это модернизированная версия «Калининграда» вышла в мир в мае 2013.

Особенности

В технологию внедрена функция слежения за изменчивыми интересами пользователей. То есть при наличии двух совершенно разных поисковых взглядов за определенный период времени, алгоритм предпочтет последний и включит его в поисковую выдачу.

Результаты

Для сайтов практически ничего не изменилось. Продолжается борьба не просто за трафик, а за улучшение поведенческих показателей. Старые макеты сайтов начинают забрасываться, потому что проще делать новый, чем пытаться исправить что-то на старом. Предложение услуг шаблонов сайтов увеличивается, начинается конкуренция за удобные и красивые макеты вебресурсов.

Острова

Алгоритм «Острова» — внедрена технология показа интерактивных блоков в поисковой выдаче, позволяя взаимодействовать пользователю с сайтом прямо на странице Яндекс поиска. Алгоритм был запущен в июле 2013 года, с предложением к вебмастерам активно поддержать бета-версию и использовать шаблоны создания интерактивных «островов». Сейчас технология тестируется в закрытом режиме.

Особенности

Теперь пользователю при поиске информации, которую можно узнать сразу из поиска предлагались «острова» — формы и другие элементы, с которыми можно работать, не посещая сайт. Например, вы ищете конкретный фильм или ресторан. По фильму в поиске и справа от него отобразятся блоки с обложкой фильма, его названием, составом актеров, часами прохождения сеансов в кинотеатрах в вашем городе и формой покупки билетов. По ресторану будет показано его фото, адрес, телефоны, форма бронирования столика.

Результаты

Ничего существенного в ранжировании сайтов сначала не изменилось. Единственное, что стало заметным — это появление вебресурсов с интерактивными блоками на первом месте и справа от поисковой выдачи. Если бы количество площадок, принимавших участие в бета-тестировании было значительным, они могли бы вытеснить обычные сайты за счет своей привлекательности и броскости для пользователей. Оптимизаторы задумались об улучшении видимости своего контента в поисковых результатах, добавляя больше фото, видео, рейтинги и отзывы. Лучше живется интернет-магазинам — корректно настроенные карточки товара могут быть отличным интерактивным «островком».

Минусинск

Алгоритм «Минусинск» — при определении SEO-ссылок как таковых, которые были куплены для искажения результатов ранжирования поиска, на сайт ложился фильтр, который существенно портил позиции сайта. Анонсирован «Минусинск» в апреле 2015, полностью вступил в свои права в мае этого же года. Именно с этим алгоритмом и связана знаменитая .

Особенности

Перед выходом «Минусинска» Яндекс в 2014 для тестирования отключил влияние SEO-ссылок по множеству коммерческих ключей в Москве и проанализировал результаты. Итог оказался предсказуемым — покупная ссылочная масса все еще используется, а для поисковой системы — это спам. Выпуск «Минусинска» знаменовался днем, когда владельцы сайтов должны были почистить свои ссылочные профили, а бюджет, который тратится на ссылочное продвижение, использовать для улучшения качества своего интернет-ресурса.

Результаты

«Авторитетные» сайты, которые добились ТОПа благодаря массовой закупке ссылок, вылетели из первых страниц, а некоторые получили санкции за нарушения правил. Качественные и молодые площадки, не наглеющие по бэклинкам, внезапно оказались в ТОП 10. «Попавшие под раздачу» вебсайты, нежелающие долго ждать, создавали новые площадки, перенося контент и ставя заглушку на старые, либо хитро шаманили с редиректом. Примерно через 3 месяца нашли дыру в алгоритме, позволяющую почти моментально снимать данный фильтр.

Массово начинает дорабатываться юзабилити и улучшаться контент. Ссылки закупаются с еще большей осторожностью, а контроль за бэклинками становится одной из функциональных обязанностей оптимизатора.

По данным на сегодня — при неумелой закупке ссылок — даже за 100 ссылок можно получить фильтр. Но если ссылочную массу правильно разбавлять, то смело можно покупать тысячи ссылок как и в старые добрые. То-есть, по сути — сильно выросли ссылочные бюджеты на это самое разбавление, в роли которого выступил крауд и упоминания.

Владивосток

Алгоритм «Владивосток» — внедрение в поиск технологии проверки сайта на полную совместимость с мобильными устройствами. Полный старт проекта произошел в феврале 2016 года.

Особенности

Яндекс сделал очередной шаг навстречу к мобильным пользователям. Специально для них был разработан алгоритм «Владивосток». Теперь для лучшего ранжирования в мобильном поиске сайт обязан соответствовать требованиям мобилопригодности. Чтобы опередить своих конкурентов в поисковой выдаче интернет-ресурс должен корректно отображаться на любом web-устройстве, включая планшеты и смартфоны. «Владивосток» проверяет отсутствие java и flash плагинов, адаптивность контента к расширению экрана (вместимость текста по ширине дисплея), удобство чтения текста и возможность комфортно нажимать на ссылки и кнопки.

Результаты

К запуску алгоритма «Владивосток» мобилопригодными оказались всего 18% сайтов — остальным пришлось быстренько избавляться от «тяжести» на страницах, которая не отображается или мешает корректно отображаться контенту на смартфонах и планшетах. Основным фактором, который влияет на понижение вебсайта в мобильной выдаче — это поведение мобильного пользователя. Во всяком случае, пока. Ведь идеально мобилопригодных сайтов не так уж много, поэтому свободные места в поиске занимают те, кто способен предоставить пользователю максимально комфортные условия, пусть даже не полностью. Из мобильного поиска неадаптированные к мобильным устройствам сайты не выбрасываются, а просто ранжируются ниже тех, кто достиг в улучшении качества предоставления услуг для смартпользователей лучших результатов. На данный момент самый популярный вид заказов макетов сайтов — адаптивные, а не мобильные, как можно было подумать. Прошедшие все требования алгоритма сайты получают максимальное количество мобильного трафика в своей нише.

Google: история создания и развития алгоритмов

Алгоритмы и фильтры Гугла и до сей поры не совсем поняты русскоязычным оптимизаторам. Для компании Google всегда важным моментом являлось скрытие подробностей по методам ранжирования, объясняя это тем, что «порядочным» сайтам боятся нечего, а «непорядочным» лучше не знать, что их ожидает. Поэтому про алгоритмы Гугла до сих слагают легенды и множество информации было получено только после того, как задавались вопросы поддержке, когда сайт проседал в поисковой выдаче. Мелких доработок у Google было столько, что и не перечесть, а на вопросы, что именно изменилось, зарубежная ПС просто отмалчивалась. Рассмотрим основные алгоритмы, которые влияли на позиции сайтов существенно.

Кофеин

Алгоритм «Кофеин» — на первой странице поиска может находиться сразу несколько страниц одного и того же сайта по бренду, появляется возможность пред просмотра. Запуск произошел в июне 2010 года.

Особенности

Выделение сайтов компаний, в случае поиска по бренду. Возле строки с выдачей появляется «лупа» для предосмотра. Ключевые слова по бренду дают положительную тенденцию роста на позициях интернет-ресурса в целом. Обновился индекс Page Rank, при этом PR повысился на известных и посещаемых площадках.

Результаты

Оптимизаторы стали больше уделять внимания брендированию вебсайтов, включая цветовые схемы, логотипы, названия. Ключевые слова на бренд по-особенному выделяли страницы сайта в поиске, а при переходе с такой фразы посетителя на главный page, его позиции в выдаче росли (если до этого ресурс был не лидером). СЕО-оптимизаторы стали закупать больше ссылок для повышения «цитированности». молодым и малоузнаваемым брендам практически невозможно было пробиться в ТОП выдачи.

Panda (Панда)

Алгоритм «Панда» — технология проверки сайта на качество и полезность контента, включая множество СЕО факторов. Сайты с «черным» SEO исключаются из поиска. Анонсирована «Panda» в январе 2012 года.

Особенности

«Панда» вышла в поиск и почистила его от мусора. Именно так можно сказать после того, как множество не релевантных ключевым запросам web-сайты исчезли из выдачи Google. Алгоритм обращает внимание на: переспам ключевыми словами и неравномерное их использование, уникальность контента, постоянство публикаций и обновления, активность пользователя и взаимодействие его с сайтом. Пролистывание посетителя страницы до конца со скоростью чтения считалось положительным фактором.

Результаты

После включения «Панды» огромное количество сайтов поддались санкциям с боку поисковой системы Google и поначалу все думали, что это связано с участием в ссылочных пирамидах и закупкой ссылочных масс. В итоге, СЕОоптимизаторы провели процесс тестирования алгоритма и проанализировали влияние. Вывод экспериментов заключался в том, что «Панда» все-таки проверяет качество сайта на ценность для посетителей. Интернет-ресурсы перестали копипастить и активно принялись за копирайтинг. Поведенческие факторы улучшались за счет преобразования структуры сайта в более удобные варианты, а перелинковка внутри статей с помощью особых выделений стала важной частью оптимизации. Популярность SEO как услуги стремительно возросла. Замечено, что сайты, не соответствующие правилам «Панды», исчезали из поиска очень быстро.

Page Layout (Пейдж Лайот)

Алгоритм «Пейдж Лайот» — технология по борьбе с поисковым спамом, подсчитывающая на страницах web-сайтов соотношение полезного контента к спамному. Запущен в январе 2012 и обновлялся до 2014 включительно.

Особенности

«Page Layout» был создан после многочисленных жалоб пользователей на недобросовестных владельцев сайтов, у которых на страницах подходящего контента было совсем мало или искомые данные оказывались труднодоступными, а иногда вообще отсутствовали. Алгоритм рассчитывал в процентном соотношении нахождение на странице по входящему запросу релевантного контента и спама. На несоответствующие требованиям площадки накладывались санкции и сайт выбрасывался из поиска. К несоблюдению правил размещения документов также относилось забитая рекламой шапка сайта, когда для просмотра текста требовалось перейти на второй экран.

Результаты

Слишком заспамленные рекламой сайты слетели со своих позиций, даже при том, что контент на страницах был оптимизирован под ключевые слова в меру. Нерелевантные запросам страницы были понижены в поисковой выдаче. Но площадок нагло не соблюдая правила и не беспокоясь о комфортности посетителей оказалось не так уже и много. За три обновления алгоритма приблизительное количество ресурсов, попавших под фильтр, оказалось не более 3%.

(Венеция)

Алгоритм «Венеция» — геопривязка сайта к определенному региону, учитывая при этом наличие названий городов на страницах сайта. Запущен в феврале 2012 года.

Особенности

«Венеция» требовала от вебмастеров наличие на их сайтах страницы «О нас», с указанием адреса местоположения, не обращая при этом внимания, что фактического расположения у компании могло и не быть. В контексте алгоритм искал названия городов, чтобы вывести отдельную страницу по указанному в нем региону. Начала использоваться разметка schema-creator.org, чтобы пояснить поисковому роботу свою географическую привязанность.

Результаты

Сайты выпали в поисковой выдаче по тем регионам, о которых они не упоминают на своих страницах, не учитывая геонезависимые запросы. Оптимизаторы активно включают геозависимые ключевые слова и пытаются создавать микроразметку. Контент на каждой странице персонализируется под каждый конкретный город или регион в целом. Активно стал использоваться локализированный линкбилдинг, чтобы повышать позиции по выбранному региону.

(Пингвин)

Алгоритм «Пингвин» — умная технология определения веса сайтов и качества обратных ссылок. Система редактирования накрученных показателей авторитетности интернет-ресурсов. Запущена в поиск в апреле 2012.

Особенности

«Пингвин» нацелен на войну с закупкой обратных ссылок, неестественным, то есть искусственным, набором авторитетности сайта. Алгоритм формирует свою базу значимых ресурсов, исходя от качества бэклинков. Побуждением на запуск «Пингвина» являлось появление ссылочных оптимизаторов, когда любая ссылка на вебресурс имела одинаковый вес и подымала такой сайт в поисковой выдаче. Кроме этого, в поиске начали ранжироваться наравне со стандартными интернет-ресурсами обычные профили пользователей социальных сетей, что еще больше популяризовало раскрутку обычных сайтов с помощью социальных сигналов. Одновременно с этими возможностями алгоритма система стала бороться с нерелевантными вставками поисковых запросов в keywords и в названия доменов.

Результаты

Пингвин «попустил» множество сайтов в поисковой выдаче за неестественный рост обратных ссылок и нерелевантность контента к запросам пользователей. Значимость каталогов и площадок по продаже ссылок быстро снижалось к минимуму, а авторитетных ресурсов (новостных сайтов, тематических и околотематических площадок) росло на глазах. Из-за введения алгоритма «Пингвин» у, практически, всех публичных сайтов был пересчитан PR. Популярность массовой закупки бэклинков резко упала. Сайты максимально начали подгонять ключевые фразы к контенту на страницах площадок. Началась «мания релевантности». Установка социальных кнопок на страницах в виде модулей имела массовый характер за счет быстрой индексации аккаунтов социальных сетей в поиске.

Pirate (Пират)

Алгоритм «Пират» — технология реагирования на жалобы пользователей и выявления фактов нарушения авторских прав. Старт системы произошел в августе 2012 года.

Особенности

«Пират» принимал жалобы авторов на нарушение их авторских прав владельцами сайтов. Кроме текстов и картинок, основной удар на себя приняли площадки с видео-контентом, которые размещали пиратские съемки фильмов из кинотеатров. Описания и рецензии к видео тоже подверглись фильттрованию — теперь не разрешалось копипастить под страхом наложения санкций. За большое количество жалоб на сайт за нарушения, такая площадка выкидывалась из поисковой выдачи.

Результаты

По результатам первого месяца работы «Пирата» от Google на практически всех сайтах, включая видехостинги и онлайн-кинотеатры, были заблокированы к просмотру миллионы видео-файлов, нарушающих права правообладателей. Вебсайты, имеющие только пиратский контент, оказались под санкцией и выпали из поиска. Массовая зачистка от «ворованного» контента продолжается до сих пор.

HummingBird (Колибри)

Алгоритм «Колибри» — внедрение технологии понимания пользователя, когда запросы не соответствуют точным вхождениям. Запущена система «определения точных желаний» в сентябре 2013 года.

Особенности

Теперь пользователь не изменял фразу, чтобы конкретней найти нужную информацию. Алгоритм «Колибри» давал возможность не искать по прямым точным вхождениям, а выдавал результаты из базы «расшифровки пожеланий». Например, пользователь вбивал в поисковую строку фразу «места для отдыха», а «Колибри» ранжировала в поиске сайты с данными о санаториях, отелях, СПА-центрах, бассейнах, клубах. То есть в алгоритме были сгруппирована стандартная база с человеческими фразами об их описании. Понимающая система изменила поисковую выдачу существенно.

Результаты

С помощью технологии «Колибри» сеооптимизаторы смогли расширить свое семантическое ядро и получить больше пользователей на сайт за счет морфологических ключей. Ранжирование площадок уточнилось, потому что теперь учитывались не только вхождения прямых ключевых фраз и релевантных тексту запросов, но и околотематические пожелания пользователей. Появилось понятие LSI-копирайтинг — написание текста, учитывающего латентное семантическое индексирование. То есть теперь статьи писались не только со вставкой ключевых слов, но и максимально включая синонимы и околотематические фразы.

(Голубь)

Алгоритм «Голубь» — система локализации пользователей и привязки поисковой выдачи к месту нахождения. Технология запущена в июле 2014 года.

Особенности

Месторасположение пользователя теперь играло ключевую роль для выдачи результатов. Органический поиск превратился в сплошную геолокацию. Привязка сайтов к Гугл-картам сыграла особую роль. Теперь при запросе пользователя, алгоритм сначала искал ближайшие по местоположению сайты или таргетированный контент, далее шел на удаление от посетителя. Органическая выдача видоизменилась существенно.

Результаты

Локальные сайты быстро возвысились в поиске и получили местный трафик. Интернет-площадки без геозависимости упали в позициях. Снова началась борьба за каждый город и количественно возросли ситуации, когда начали плодить одинаковые сайты с отрерайченным контентом и привязкой к разной местности. До получения точной информации о внедрении алгоритма «Голубь» в русскоязычном интернет-поиске, многие вебмастера думали, что попали под санкции «Пингвина».

(Дружелюбный к мобильным устройствам)

Алгоритм Mobile-Friendly — внедрение технологии проверки сайтов на адаптивность к мобильным устройствам. Система запущена в апреле 2015 года и успела «обозваться» в интернете как: «Мобильный Армагеддон» (mobilegeddon), «Мобильный Апокалипсис» (mobilepocalyse, mobocalypse, mopocalypse).

Особенности

Mobile-Friendly запустил новую эру для мобильных пользователей, рекомендуя оптимизаторам в срочном порядке обеспечить комфортное пребывание мобильных посетителей на их сайтах. Адаптивность площадок к мобильным устройствам стала одним из важнейших показателей заботы владельцев сайтов о своих посетителях. Неадаптивным веб-площадкам пришлось в кратчайшие сроки исправлять недоработки: избавляться от плагинов, не поддерживающихся на планшетах и смартфонах, корректировать размер текста под расширение разных экранов, убирать модули, мешающие пребыванию посетителей с маленьким экранчиком перемещаться по сайту. Кто-то просто верстал отдельную мобильную версию своего интернет-ресурса.

Результаты

Заранее готовые к такому повороту ресурсы получили особое выделение среди других интернет-площадок в поисковой выдаче, а трафик из разнообразных не декстопных устройств на такие вебсайты повысился более чем на 25%. Совсем неадаптивные сайты были понижены в мобильном поиске. Направленность на мобильность сыграла свою роль — на ресурсах свели к минимуму наличие тяжелых скриптов, рекламы и страницы, естественно, начали грузиться быстрее, учитывая, что большинство пользователей с планшетами/смартфонами используют мобильный интернет, который в разы медленнее, чем стандартный.

Резюме

Вот и все

Теперь вам известно, как по годам развивался поиск как для обычных пользователей, так и для «попавших по раздачу» сайтов. Каждый из вышеперечисленных алгоритмов поиска периодически модернизируется. Но это не значит, что оптимизаторам и вебмастерам стоит чего-то бояться (если конечно вы не используете черное СЕО), но держать ухо востро все же стоит, чтобы неожиданно не просесть в поиске из-за очередного нового фильтра.

Вчера Яндекс на своей презентации официально объявил о запуске нового алгоритма «Королёв».

Рассказываю как это происходило и что нового дал нам новый алгоритм Яндекса.

Вот самая трансляция данной презентации:

Я не буду мусолить весь этот пафос который был не презентации и скажу суть:

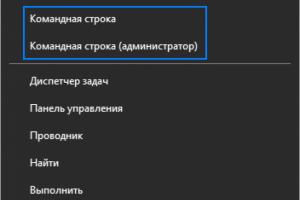

- Алгоритм «Королёв» запустили не вчера, а эдак 2-6 месяцев назад . Я думаю всем понятно, чтобы вот взять и запустить за секунду новый алгоритм невозможно.

Т.е. новый алгоритм Яндекса действует давно, просто всё это время шло его тестирование и отладка.

2. Это вовсе не новый алгоритм. Вовсе нет. Это алгоритм Палех в котором просто сделали возможность сравнения не 150, а 2000 результатов.

Ну, а а конкретно о различии Королёва и Палеха нам официально всё разъяснил сотрудник Яндекса:

По сути ничего не поменялось. Был просто пафос Яндекса и больше ничего.

Если говорить честно, то никакого нового алгоритма нет. Просто нет и всё. Даже поиск по органике остался прежним.

Если был бы внедрён новый алгоритм, но мы бы увидели колебания по трафику. Но этих колебаний нет.

Да, впринципе и искать то нечего.

Вот так выглядит в настоящее время выдача Яндекса:

А что собственно вы ищите своим поиском?!

Сверху 4 позиции Директа + 5-я позиция Маркет, потом 4 позиции Директа снизу, справа Яндекс.Маркет + Яндекс.Баян.

Что то тут искать?

Какой к хуям алгоритм ранжирования сайтов? Что тут ранжировать?

Я даже нарисовал новый логотип Яндекса:

А Королёв тут причём? Вам до Королёва как до Луны. Подмазались под великого человека.

Я вообще не понимаю, что произошло. Было обычный пафос Яндекса и всё. Никакого глобального изменения в алгоритме ранжирования сайтов нет.

Теперь пройдёмся по самой презентации этого алгоритма.

За месяц до презентации Яндекс объявил, что вы можете подать заявку, чтобы вживую в планетарии посмотреть эту презентацию.

Я лично заполнял заявку. Да и много кто заполнял. И всем нам пришёл отказ.

Всё на самом деле оказалось проще:

Просто собрали своих сотрудников, родственников, знакомых, подруг и знакомых своих знакомых.

Зачем вообще мы подавали на что то заявки?! Ну теперь понятно кого вы набираете на работу в Яндекс.

Но по видимому набрали слишком много знакомых и многие из них тупо спали:

Ебала, я все ваши алгоритмы, я спать хочу….

Ебала, я все ваши алгоритмы, я спать хочу….

Вот это человек пришёл на место Саши Садовского:

22 августа 2017 Яндекс запустил новую версию поискового алгоритма – «Королёв». Максимально кратко и емко можно описать его суть словами из пресс-релиза Яндекса:

Запуск алгоритма состоялся в Московском планетарии и сопровождался докладами разработчиков алгоритма, торжественным нажатием кнопки запуска и даже звонком на МКС и прямым эфиром с космонавтами.

Полное видео презентации можно посмотреть прямо здесь, а ниже мы рассмотрим основные изменения и ответы на частые вопросы. Информацию мы будем сопровождать комментариями сотрудников Яндекса в блоге компании, а также цитатами из официальных источников.

Что изменилось в поиске Яндекса?

«Королев» – это продолжение алгоритма «Палех », представленного в ноябре 2016 года. «Палех» был первым шагом в сторону семантического поиска, задача которого – лучше понимать смысл страниц.

«Королев» же теперь умеет понимать смысл всей страницы, а не только заголовка title, как было после анонса «Палеха».

Алгоритм должен улучшить выдачу по редким и сложным запросам.

Документы могут не содержать многих слов запроса, поэтому традиционные алгоритмы определения текстовой релевантности не справятся с этой задачей.

Выглядит это примерно так:

В Google работает аналогичный алгоритм – RankBrain:

Область действия алгоритма «Королев» распространяется на все запросы, в том числе на коммерческие. Однако больше всего влияние заметно именно на многословных запросах. Яндекс подтвердил, что алгоритм работает на всем поиске.

Конечно, целью алгоритма было улучшение качества выдачи по редким и сложным вопросам. Проверим на редких и сложных коммерческих запросах, связанных как раз с названием предмета.Например, в этом случае Яндекс действительно понимает, о чем идет речь. Правда, в выдаче в основном обзоры и статьи, а не коммерческие сайты.

А в этом случае поисковик понял, что меня, скорее всего, интересует дрон или квадрокоптер. Конечно же, выдача начинается с Яндекс.Маркет:

Но в некоторых случаях Яндекс бессилен…

Как это работает (+ 11 фото из презентации)

Разберем подробнее презентацию нового алгоритма. Ниже будут только выдержки самых интересных моментов с нашими комментариями и слайды из презентации.

Новая версия поиска основана на нейронной сети. Она состоит из большого количества нейронов. У нейрона есть один выход и несколько входов, он умеет суммировать полученную информацию и после преобразования передавать ее дальше.

Нейронная сеть может выполнять гораздо более сложные задачи и ее можно обучить понимать смысл текста. Для этого нужно дать ей много обучающих примеров.

Работу в этом направлении Яндекс начал с модели DSSM, состоящей из двух частей, соответствующих запросу и странице. На выходе была оценка, насколько они близки по смыслу.

Для обучения нейросети нужно много обучающих примеров.

Отрицательные – это пара текстов, не связанных по смыслу.

Положительные – пары «текст-запрос», связанные по смыслу.

Согласно презентации, Яндекс использовал для обучения массив данных о поведении пользователей на выдаче и считал связанными по смыслу запрос и страницу, на которую часто кликают пользователи в выдаче. Но как позже пояснил Михаил Сливинский, удовлетворенность пользователя результатами поиска меряются не только кликами:

Как ранее рассказывал в презентации "Палеха" Александр Садовский, наличие клика не говорит о том, что документ релевантен, а отсутствие, что не релевантен. Модель Яндекса предсказывает, задержится ли пользователь на сайте и учитывает множество других метрик удовлетворенности пользователя.

После обучения модель представляет текст в виде набора 300 чисел – семантического вектора. Чем ближе тексты по смыслу, тем больше сходство чисел векторов.

В поиске Яндекса нейронные модели использовались давно, но в алгоритме «Королёв» увеличено влияние нейронных сетей на ранжирование.

Теперь при оценке смысловой близости алгоритм смотрит не только на заголовок, но и на текст страницы.

Параллельно Яндекс работал над алгоритмом сравнения смыслов запросов на основании нейронных сетей. Например, если для одного запроса поисковая система точно знает лучший ответ, а пользователь ввел запрос, очень близкий к нему, тогда результаты поиска должны быть похожи. В качестве иллюстрации такого подхода Яндекс приводит пример: «ленивая кошка из монголии» – «манул». ()

В «Палехе» нейронные модели применялись только на самых поздних стадиях ранжирования, приблизительно на 150 лучших документов. Поэтому на ранних стадиях ранжирования часть документов терялась, а они могли быть хорошими. Это особенно важно для сложных и низкочастотных запросов.

Теперь вместо вычисления семантического вектора во время исполнения запроса Яндекс делает вычисления заранее – при индексации. «Королёв» проводит вычисления на 200 тыс. документов на запрос, вместо 150, которые были раньше при «Палехе». Сначала такой метод предварительного расчета был испытан на «Палехе», это позволило сэкономить на мощности и находить соответствие запросу не только заголовка, но и текста.

Поисковик берет полный текст на этапе индексации, проводит нужные операции и получает значение. В итоге для всех слов и популярных пар слов формируется дополнительный индекс со списком страниц и их предварительной релевантностью запросу.

Команда Яндекса, которая занималась проектированием и внедрением нового поиска, запускает его.

Запуск алгоритма:

Обучение искусственного интеллекта

В Яндексе уже много лет задачей сбора данных для машинного обучения занимаются асессоры, которые оценивают релевантность документов запросу. С 2009 по 2013 год поисковик получил более 30 млн таких оценок.

За это время появился поиск по картинкам, по видео, внутренние классификаторы и алгоритмы: количество проектов Яндекса выросло.

Так как все они работали на технологиях машинного обучения, требовалось больше оценок и больше асессоров. Когда асессоров стало больше 1500, Яндекс запустил краудсорсинговую платформу «Толока» , где может зарегистрироваться и выполнять задания любой человек.

Например, вот такие задания встречаются в «Толоке»:

Или такие:

Если хотите подробнее узнать, как пользователи оценивают релевантность ответов, чтобы понимать, какие параметры выдачи оцениваются, рекомендуем почитать инструкции по заданиям или даже попробовать пройти обучение.

За несколько лет в сервисе собралось более 1 млн человек, которые сделали более 2 млрд оценок. Это позволило Яндексу сделать огромный рывок в масштабировании и объеме обучающих данных. Только в 2017 году задания выполняли более 500 000 человек.

Среди заданий есть:

- Оценка релевантности документов;

- Задания для развития карт. Так проверяют актуальность данных об организациях для базы Справочника;

Задания для настройки речевых технологий голосового поиска.

Правила, которым Яндекс хочет научить алгоритм, открыты всем зарегистрированным пользователям в виде инструкций для работников «Толоки». По некоторым заданиям просто собирается субъективное мнение людей.

Вот выдержка из инструкции о том, как Яндекс определяет релевантность документа:

Яндексу очень важно качество оценок. Оно может быть субъективно, поэтому задания даются сразу нескольким людям, а потом математическая модель оценивает распределение голосов с учетом степени доверия к каждому работнику и экспертизы каждого участника. Для каждого «толокера» хранятся данные о точности оценок по каждому проекту и сводятся в единый рейтинг.

Именно поэтому нельзя сетовать на то, что необъективность асессоров погубила ваш сайт.

Таким образом, в Яндексе появилась дополнительная группа факторов:

- Смысл страницы и соответствие ее запросу;

- Является ли документ хорошим ответом на похожие пользовательские запросы.

Что изменилось в топе Яндекса?

Алгоритм предположительно был запущен несколько раньше презентации и, если верить сторонним сервисам (например, https://tools.pixelplus.ru/updates/yandex), изменения в выдаче начались еще в начале августа, но неизвестно, связано ли это с алгоритмом «Королев».

По этим данным можно выдвинуть гипотезу, что уменьшение доли главных страниц в топ-100 и уменьшение возраста документов в пределах топ-100 связано с новым алгоритмом, который помогает получить больше релевантных ответов.

Правда, при этом заметных изменений в топ-10, топ-20 или топ-50 не видно. Возможно, их там нет либо они незначительны. Мы также не заметили существенных изменений выдачи по продвигаемым запросам.

Текстовая релевантность в стандартном понимании никуда не делась. Подборки и более широкие ответы по многословным запросам содержат большое количество страниц с вхождениями слов запроса в title и текст:

Свежесть результатов поиска тоже имеет значение. Пример из презентации Яндекса содержит ряд свежих результатов с искомой фразой целиком.

Хотя, учитывая тот факт, что алгоритм проводит расчеты сразу при индексации, «Королев» теоретически может влиять и на подмешивание результатов быстроботом.

Надо ли как-то оптимизировать тексты под «Королев»?

Скорее наоборот: чем больше поисковик учится определять смысл текста, тем меньше требуется вхождений ключевых слов и тем больше требуется смысла. Но принципы оптимизации не меняются.

Например, еще в 2015 году Google рассказал об алгоритме RankBrain, который помогает поиску лучше отвечать на многословные запросы, заданные на естественном языке. Он неплохо работает, что отметили пользователи в многочисленных публикациях сравнения поиска Яндекса и Google после анонса новой версии алгоритма.

Это не сопровождалось масштабной презентацией и сильно не повлияло на работу специалистов. Никто целенаправленно не занимается «оптимизацией под RankBrain», поэтому и в Яндексе это никак глобально не меняет работу специалиста. Да, появился тренд на поиск и включение в текст так называемых LSI-ключей, но это явно не просто часто повторяющиеся слова на страницах конкурентов. Ожидаем развития SEO-сервисов в этом направлении.

В алгоритме также заявлено, что анализируется смысл и других запросов, по которым пользователи попадают на страницу. Опять же, в перспективе это должно дать одинаковую или похожую выдачу по синонимичным запросам, так как сейчас результат анализа выдачи порой показывает, что пересечений по синонимичным запросам в выдаче нет. Будем надеяться, что алгоритм поможет устранить подобные несоответствия.

Но Яндекс пока не может найти (или плохо находит) документы, близкие по смыслу к запросу, но вовсе не содержащие слов запроса ().

Советы:

Убедитесь, что страница отвечает на запросы, под которые она оптимизирована и по которым переходят пользователи.

Убедитесь, что страница все же включает слова из поисковых запросов. Мы не говорим про прямые вхождения, просто проверьте, есть ли слова из запросов в любой форме на странице.

Тематические слова могут придать странице дополнительную релевантность, но это явно не просто часто повторяющиеся слова на страницах конкурентов. Ожидаем развития SEO-сервисов в этом направлении.

Для ключевых фраз, по которым страница сайта хорошо ищется, проверьте, не выбивается ли показатель отказов из среднего показателя по сайту. Если по запросу сайт находится на высокой позиции и пользователь находит то, что ему нужно, сайт может быть показан по сходным по смыслу ключевым фразам (если такие есть).

Клики на поиске показывают удовлетворенность пользователя результатом. Это не ново, но стоит еще раз проверить сниппеты по ключевым запросам. Возможно, где-то получится повысить кликабельность.

Как проверить влияние алгоритма на свой сайт?

Для сайтов, у которых нет ярко выраженной сезонности, вы можете сравнить количество низкочастотных ключевых фраз, по которым переходили на сайт до запуска алгоритма и после. Например, взять неделю в июле и неделю в августе.

Выбираем «Отчеты – Стандартные отчеты – Источники – Поисковые запросы».

Выбираем визиты из Яндекса:

И фильтром оставляем только те запросы, по которым был 1 переход. Дополнительно стоит исключить фразы, содержащие название бренда.

Также можете посмотреть наличие поисковых фраз, слов из которых у вас нет в тексте. В целом, такие фразы присутствовали среди НЧ-запросов и раньше, просто сейчас их может стать заметно больше.

Перспективы и прогноз

Поисковик сможет еще лучше находить документы, близкие по смыслу к запросу. Наличие вхождений станет еще менее важным.

К текущему алгоритму будет добавлена персонализация.

В перспективе хорошие материалы, отвечающие на вопрос пользователя, могут получить еще больше трафика по микрочастотным, редким или семантически похожим запросам.

По низкочастотным ключевым фразам может увеличиться конкуренция за счет большей релевантности неоптимизированных документов.

Гипотеза. С помощью подобных алгоритмов Яндекс может лучше оценивать, насколько семантически связаны страницы, ссылающиеся на другие, и учитывать это для оценки внешних ссылок. Если это может быть значимым фактором с учетом слабого влияния ссылок в Яндексе.

Нам стоит ожидать дальнейших изменений, связанных с нейросетями, и в других сервисах Яндекса.

Вопрос-ответ

Вопрос : так как Яндекс оценивает клики, значит ли это, что накрутка поведенческих факторов будет набирать обороты?

Вопрос : связан ли «Королев» с «Баден-Баденом»?

Вопрос : как включить новый поиск Яндекса?

Ответ : в блоге Яндекса и в поисковых запросах часто встречались вопросы, как включить или установить новый поиск. Никак . Новый алгоритм уже работает и никаких дополнительных настроек делать не нужно.

«Королев» — это не Минусинск, не Баден-Баден. Это не карательный фильтр. Он, кстати, не является надстройкой — является частью основного алгоритма Яндекса.

«Королев» работает на основе самообучаемой нейронной сети и затрагивает довольно редкие многословные запросы, в первую очередь информационные, которые направлены на уточнение смысла — низкочастотные (НЧ) и микроНЧ, в том числе голосовой поиск, разные естественные варианты запросов, типа «фильм, где мужик в разных ботинках».

Создан этот алгоритм был с целью улучшить качество выдачи по таким запросам, по аналогу с RankBrain Гугла, который давно с такой задачей хорошо справляется, да и сейчас, по первым замерам, работает по таким запросам лучше Яндекса.

До этого был и есть алгоритм «Палех», который уже начал искать по смыслу, но делал это в реальном времени и сопоставлял только смысл запроса и заголовка — Title страницы.

«Королев» анализирует не только Title, но и всю страницу в целом, показывает в выдачу даже те страницы, где нет упоминания слов из запроса, но по смыслу страница подходит. При этом он определяет суть страницы заранее, на этапе индексирования — в результате скорость и количество обрабатываемых страниц мощно увеличились.

Про «треть» тут может быть преувеличено — реальной доли запросов, которые затронет «Королев», пока еще никто не измерял.

Другие статьи про «Королев»:

Я много моментов тут еще не расписывала, про них стоит почитать в других статьях. Я выбрала тут только самые лучшие, действительно стоящие:

Мнения разных экспертов:

Дополнительные официальные источники:

Некоторые отрывки из мнений по ссылкам выше:

Дмитрий Шахов

«Королев» пройдет мимо поисковой оптимизации. По крайней мере, на данном этапе. Перед поиском стоит задача дать ответы по запросам, по которым нет документов с вхождениями. Поиск эту задачу решает. Hummingbird в Google, «Палех» и «Королев» в Яндексе. Запросы, по которым нет документов, не входят в зону интереса поисковой оптимизации. Именно поэтому там и нет документов.

Артур Латыпов

Многие ждали, что вскоре после «Палеха» появится алгоритм, который будет работать аналогично, но не по заголовкам, а по контенту. Пока не заметили скачков трафика на наблюдаемых сайтах, будем наблюдать внимательней и смотреть на развитие алгоритма в будущем. Интересно, раньше для улучшения ранжирования по большому количеству запросов, в том числе смежных, готовили SEO-тексты, они были у кого-то лучше, у кого-то хуже, кто-то их называл по-другому, но смысл от этого не менялся. Теперь за SEO тексты наказывают, а поиск будет ранжировать документы по смыслу.

Ожидаем, что в работе оптимизаторы будут больше использовать LSI при подготовке текстовой оптимизации.

Соответственно, будут развиваться SEO-сервисы. Напомню, что подготовка списка SEO-слов, терминов в тематике, смежных запросов для подготовки контента и оптимизации, используется специалистами уже несколько лет. Поэтому серьезных изменений в механике не произойдет, по крайней мере пока.

В итоге, больше внимания уделяем:

Качеству контента;

интенту запроса;

мониторингу выдачи.

И, конечно, всегда интересно после запуска нового алгоритма от Яндекса анализировать, что изменилось, и наблюдать, что будет дальше.

Дмитрий Севальнев

Фактически, с внедрением ряда новых факторов, которые учитывают:

смысловое соответствия пары запрос-документ (по всему тексту документа, а не только по Title, как ранее в алгоритме «Палех»),

качество ответа документа на схожие по смыслу поисковые запросы, –

не будет глобальных изменений для SEO-индустрии. Наиболее значимые изменения коснутся «длинного хвоста» запросов, под которые целенаправленно SEO-специалисты мало работают. Их много, они редкие и часто обеспечивают единичные заходы на сайт.

Может быть увеличена значимость ряда факторов, которые и так прорабатываются специалистами, с того момента как LSI стал «модной темой».

Олег Шестаков, CTO & Founder в Rush Analytics Russia

Анонс алгоритма «Королев» был, наверное, самым масштабным за все время с точки зрения шоу. С точки зрения технологий нельзя сказать, что это какой-то новый технологический прорыв. В чем смысл инновации: теперь нейронные сети Яндекса оценивают соответствие запрос-документ не просто с точки зрения вхождения запроса и его вариаций (леммы, частей запроса и т.д.) в текст документа, но и с точки зрения смысла запроса. Нейронная сеть, обученная на больших данных, теперь умеет определять релевантность документа запросу, даже если в документе нет вхождения слов запроса. На самом деле – это не новая технология – она же использовалась в алгоритме «Палех», правда он учитывал лишь заголовки документов. Т.е. настоящая инновация здесь в том, что инженеры Яндекса сумели масштабировать очень ресурсоемкий алгоритм на несколько порядков – теперь алгоритм может оценивать сотни тысяч документов, а не 150 строк текста как раньше.

Как алгоритм повлияет на рынок SEO?

— Глобально – никак. Это всего лишь часть алгоритма, а большинство других факторов как работали, так и будут работать. Данный алгоритм сильнее всего должен затронуть НЧ-запросы и часть СЧ-запросов.

— Придется уделять больше внимания качеству текстов. Теперь, чтобы вывести страницу в ТОП, текст страницы должен содержать как можно больше слов-синонимов и связанных с запросом слов, чтобы пройти по факторам нового алгоритма, т.к. он теперь учитывает именно такие слова, а не просто «прямые вхождения». Здесь нет никакой магии – нейросеть обучается учителями-асессорами и все равно работает с текстами реальных сайтов, находя связанные по смыслу слова. Значит можно провести похожий анализ и сделать экстракцию этих слова их документов ТОПа. Грамотные SEO-специалисты начали это делать уже несколько лет назад. Если простыми словами – тот же LSI, только в профиль.

— Рынок дешевого копирайтинга начнет схлопываться, и это очень хорошо. Задание на написание текста в формате «3 прямых вхождения, 4 разбавленных и длина 2500 символов» будет порождать тексты, которые будут слабо ранжироваться.

Теперь нужны тексты-истории. Мы как SEO-специалисты должны рассказать историю про продукт клиента во всех подробностях, описав продукт со всех сторон – при таком подходе будет физически сложно упустить важные тематичные запросу слова. Заметьте, что вебмастера, зарабатывающие на статейных сайтах, уже очень давно пишут тексты-истории даже о юристах по алиментам, с отличной версткой, раскрытием темы и points of interest. Что в результате? У них куча трафика и ТОПы, плюс тотальная победа над сухими сайтами юридических фирм.

Производство контента станет несколько дороже и профессиональнее. SEO-компании либо перестанут писать SEO-бред и построят взрослые контент-редакции внутри, или их клиенты потеряют позиции в поиске. Яндекса вчера толсто на это намекнул.

Александр Алаев

«Королев» со всем не про SEO. Цель SEO – работа с запросами, которые спрашивают много раз и смысл их понятен, а релевантных ответов тысячи. Задача поисковика в коммерческом сегменте – найти лучших кандидатов по коммерческим критериям, а не искать смыслы. Именно поэтому коммерческая выдача не изменится, по крайней мере сколько-либо заметно.

А вот владельцам информационных ресурсов еще раз стоит обратить внимание на качество контента, ориентировать свои публикации не под поисковые запросы, а под интересы пользователей, писать человеческим простым языком.

Все мои проекты, кроме этого SEO-блога:

ТОП База - качественная база для полуавтоматической регистрации с Allsubmitter или для полностью ручного размещения - для самостоятельного бесплатного продвижения любого сайта, привлечения целевых посетителей на сайт, поднятия продаж, естественного разбавления ссылочного профиля. Базу собираю и обновляю 10 лет. Есть все виды сайтов, все тематики и регионы.

SEO-Topshop - SEO-софт со СКИДКАМИ, по выгодным условиям, новости SEO-сервисов, баз, руководств. Включая Xrumer по самым выгодным условиям и с бесплатным обучением, Zennoposter, Zebroid и разные другие.

Мои бесплатные комплексные курсы по SEO

- 20 подробных уроков в формате PDF.

- каталоги сайтов, статей, пресс-релизовые сайты, доски объявлений, каталоги фирм, форумы, соцсети, блоговые системы и прочее.

"Приближаясь.." - мой блог на тему саморазвития, психологии, отношений, личной эффективности